Tin tức AI

Vectara Portal giúp người dùng không chuyên tạo ứng dụng AI để trò chuyện với dữ liệu: Cách sử dụng

Vectara vừa đơn giản hóa việc phát triển trí tuệ nhân tạo tạo sinh. Công ty có trụ sở tại Palo Alto, Calif., là công ty tiên phong trong lĩnh vực tạo tăng cường truy xuất (RAG), đã công bố Vectara Portal, một môi trường mã nguồn mở cho phép bất kỳ ai cũng có thể xây dựng các ứng dụng AI để “trò chuyện” với dữ liệu của họ.

Mặc dù có rất nhiều dịch vụ thương mại giúp người dùng nhận được câu trả lời tức thì từ tài liệu, nhưng điều khiến Vectara Portal khác biệt là khả năng truy cập và sử dụng dễ dàng. Chỉ với một vài bước cơ bản, bất kỳ ai, bất kể kỹ năng hay kiến thức kỹ thuật của họ, đều có thể có một ứng dụng tìm kiếm, tóm tắt hoặc trò chuyện theo ý của mình, dựa trên bộ dữ liệu của họ. Không cần phải viết dù chỉ một dòng code.

Dịch vụ này có tiềm năng cho phép những người không phải là nhà phát triển hỗ trợ một số trường hợp sử dụng trong tổ chức của họ, từ chính sách đến tìm kiếm hóa đơn. Tuy nhiên, điều quan trọng cần lưu ý là hiệu suất vẫn chưa được đánh giá đầy đủ vì công cụ này vẫn còn rất mới và chỉ một số ít khách hàng đang thử nghiệm bản beta.

Ofer Mendelevitch, người đứng đầu bộ phận quan hệ nhà phát triển của Vectara, nói rằng vì Portal được hỗ trợ bởi nền tảng RAG-as-a-service độc quyền của Vectara, họ hy vọng sẽ thấy sự áp dụng rộng rãi bởi những người không phải là nhà phát triển. Điều này sẽ dẫn đến sự gia tăng sức hút cho các dịch vụ cấp doanh nghiệp đầy đủ của công ty.

“Chúng tôi đang háo hức theo dõi những gì người dùng sẽ xây dựng với Vectara Portal. Chúng tôi hy vọng rằng mức độ chính xác và phù hợp được làm phong phú bởi tài liệu của họ sẽ thể hiện sức mạnh tổng thể của hệ thống RAG doanh nghiệp (của Vectara),” ông nói.

Cách thức hoạt động của Vectara Portal

Cổng thông tin có sẵn dưới dạng ứng dụng được Vectara lưu trữ cũng như dịch vụ mã nguồn mở theo giấy phép Apache 2.0. Vectara Portal xoay quanh ý tưởng người dùng tạo cổng thông tin (ứng dụng tùy chỉnh) và sau đó chia sẻ chúng với đối tượng mục tiêu của họ để sử dụng.

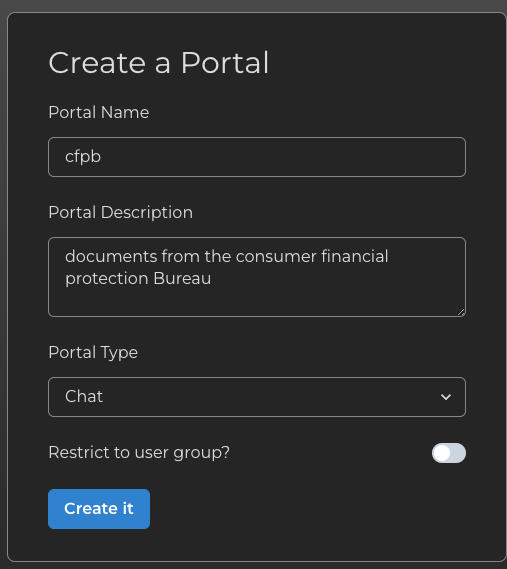

Đầu tiên, người dùng phải tạo tài khoản Portal bằng thông tin đăng nhập tài khoản Vectara chính của họ và thiết lập hồ sơ đó bằng ID Vectara, Khóa API và ID ứng dụng khách OAuth của họ. Khi hồ sơ đã sẵn sàng, người dùng chỉ cần đi tới nút “tạo cổng thông tin” và điền các thông tin cơ bản như tên ứng dụng dự kiến, mô tả của ứng dụng và liệu nó có được cho là hoạt động như một công cụ tìm kiếm ngữ nghĩa, ứng dụng tóm tắt hay trợ lý trò chuyện thông thường. Sau đó, nhấn nút tạo sẽ thêm nó vào trang quản lý Portal của công cụ.

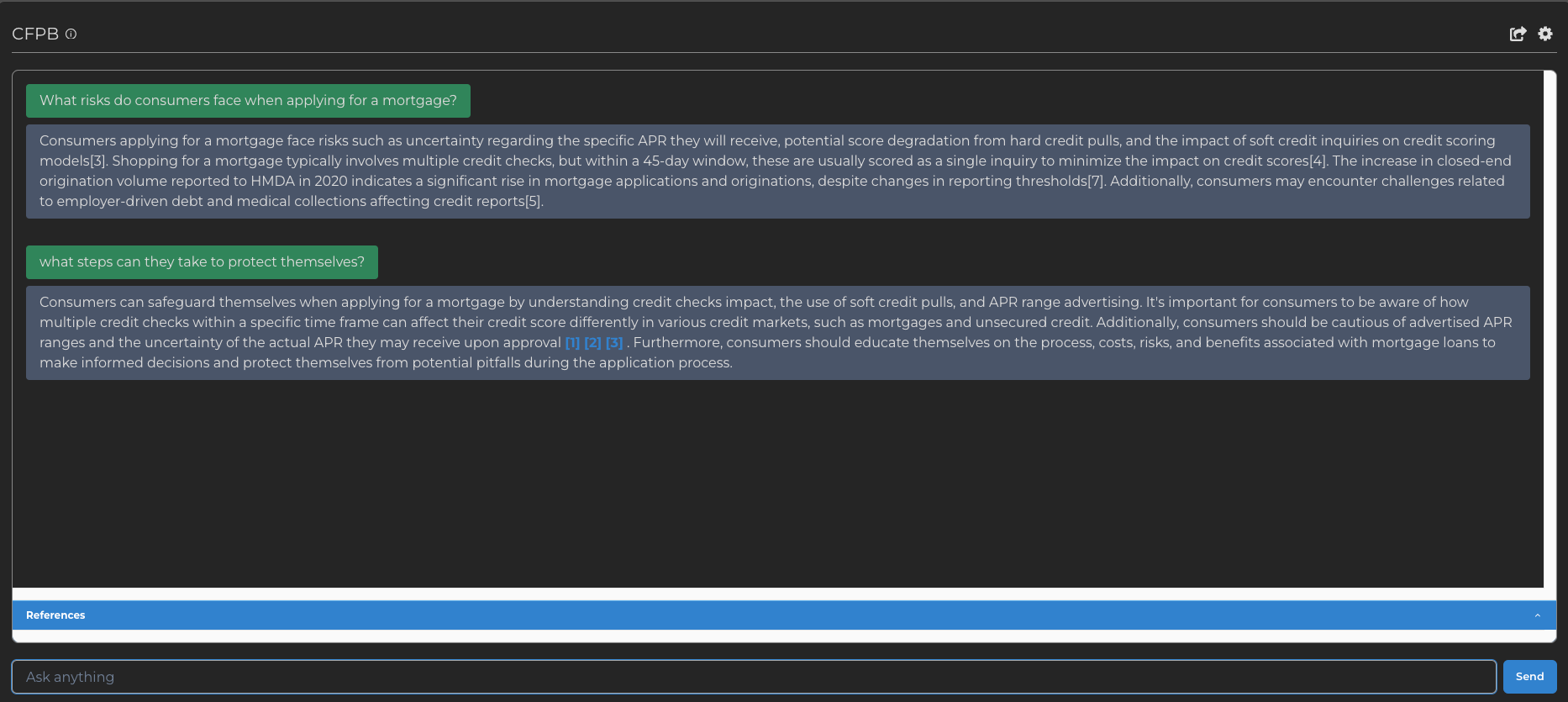

Từ màn hình quản lý Portal, người dùng mở cổng thông tin đã tạo, đi vào cài đặt của nó và thêm bất kỳ số lượng tài liệu nào để định hình/tùy chỉnh ứng dụng theo dữ liệu của họ. Khi các tệp này được tải lên, chúng được lập chỉ mục bởi nền tảng RAG-as-a-service của Vecatara, nền tảng hỗ trợ phụ trợ của cổng thông tin, để cung cấp câu trả lời chính xác và không có ảo giác.

“Điều này (nền tảng) có nghĩa là một công cụ truy xuất mạnh mẽ, mô hình nhúng Boomerang tiên tiến, bộ sắp xếp lại đa ngôn ngữ, giảm ảo giác và chất lượng tổng thể của phản hồi cho câu hỏi của người dùng trong Portal cao hơn nhiều. Là một sản phẩm không cần code, người xây dựng chỉ cần sử dụng một vài cú nhấp chuột để nhanh chóng tạo ra các sản phẩm AI tạo sinh,” Mendelevitch nói.

Người đứng đầu bộ phận quan hệ nhà phát triển lưu ý rằng khi người dùng tạo cổng thông tin và thêm tài liệu, phần phụ trợ của công cụ sẽ xây dựng một “kho văn bản” dành riêng cho dữ liệu đó trong tài khoản Vectara chính của người dùng. Kho văn bản này hoạt động như một nơi để chứa tất cả các tài liệu liên quan đến cổng thông tin. Vì vậy, khi người dùng đặt câu hỏi trên cổng thông tin, API RAG của Vectara sẽ chạy truy vấn đó dựa trên kho văn bản được liên kết để đưa ra câu trả lời phù hợp nhất.

Nền tảng đầu tiên chọn ra những phần phù hợp nhất của tài liệu (trong bước truy xuất) cần thiết để trả lời câu hỏi của người dùng và sau đó đưa những phần đó vào mô hình ngôn ngữ lớn (LLM). Vectara cung cấp cho người dùng tùy chọn chọn từ các LLM khác nhau, bao gồm LLM Mockingbird của chính công ty cũng như các LLM từ OpenAI.

“Đối với khách hàng Vectara Scale (gói lớn hơn của công ty), Portal sử dụng các tính năng tốt nhất của Vectara, bao gồm cả các LLM hiệu suất cao nhất,” Mendelevitch cho biết thêm. Các ứng dụng được công khai theo mặc định và có thể chia sẻ qua liên kết, nhưng người dùng cũng có thể hạn chế chúng cho một nhóm người dùng được chọn.

Mục tiêu tăng khách hàng doanh nghiệp

Với dịch vụ không cần code này, cả dưới dạng sản phẩm được lưu trữ và mã nguồn mở, Vectara đang tìm cách mang đến cho nhiều người dùng doanh nghiệp hơn khả năng xây dựng các ứng dụng trí tuệ nhân tạo tạo sinh mạnh mẽ nhắm mục tiêu đến các trường hợp sử dụng khác nhau. Công ty hy vọng rằng nó sẽ làm tăng số lượng đăng ký cũng như tạo tiếng vang cho dịch vụ RAG-as-a-service chính của mình, cuối cùng dẫn đến chuyển đổi tốt hơn.

“RAG là một trường hợp sử dụng rất mạnh mẽ cho nhiều nhà phát triển doanh nghiệp và chúng tôi muốn mở điều này cho những người xây dựng không cần code để họ có thể hiểu được sức mạnh của nền tảng đầu cuối của Vectara. Portal thực hiện chính xác điều đó và chúng tôi tin rằng nó sẽ là một công cụ quý giá cho các nhà quản lý sản phẩm, tổng giám đốc và các giám đốc điều hành cấp C khác để hiểu cách Vectara có thể giúp ích cho các trường hợp sử dụng AI tạo sinh của họ,” Mendelevitch nói.

Cho đến nay, công ty đã huy động được hơn 50 triệu USD tài trợ và có khoảng 50 khách hàng sản xuất, bao gồm Obeikan Group, Juniper Networks, Sonosim và Qumulo.